最新文心大模型上线千帆,性能飞跃,价格大降

大模型开发/产品动态

- 文心大模型

4月30日1976看过

千帆模型开发平台于4月25日进行了小版本更新,本次更新涉及模型服务升级以及工具链,为开发者带来更便宜、好用的开发平台。

💡此次更新亮点速览:

-

离线批量推理支持ERNIE-X1-Tubro-32k,ERNIE-4.5-Tubro-32k主干模型,ERNIE-4.5-Tubro-VL-32k多模态版本,ERNIE-4.5-Tubro-128k,价格为在线服务4折。

-

预置服务上线 Qianfan 系列、GLM-4-32B-0414 系列、Qwen2.5-7B-Instruct 模型。

-

模型评估新增裁判员自定义打分场景化Prompt模板,匹配不同业务场景。

登录百度智能云千帆大模型开发平台同步进行文字和功能的体验效果更佳。

模型服务升级

「模型更新」

一、文心大模型

1、上线ERNIE-X1-Turbo-32K模型,输入价格为1元/百万tokens,输出价格为4元/百万tokens,相比X1性能和效果都有所提升。

2、上线ERNIE-4.5-Tubro-32k、ERNIE-4.5-Tubro-128k主干模型,新版本在去幻觉、逻辑推理和代码能力等方面有着明显增强。输入价格为0.8元/百万tokens,输出价格为3.2元/百万tokens,相比文心4.5,价格下降80%,仅为DeepSeek-V3的40%。

3、上线ERNIE-4.5-Tubro-VL-32k多模态全新版本,新版本在图片理解、创作、翻译、代码等能力显著提升,首次支持32K上下文长度,首Token时延显著降低。

4、上线Qianfan-Llama-VL-8B模型,该模型是由百度智能云千帆团队推出的多模态大模型,能够同时理解图像与文本,在图像描述、视觉问答等任务中表现出高效的理解和生成能力。

5、ERNIE iRAG Edit图像编辑模型接口中image字段支持传入base64格式图片。

6、离线批量推理支持ERNIE-X1-Tubro-32k,ERNIE-4.5-Tubro-32k主干模型,ERNIE-4.5-Tubro-VL-32k多模态版本,ERNIE-4.5-Tubro-128k,价格为在线服务4折。

-

计费详情:

-

使用说明文档:

二、第三方大模型

1、支持Qwen2.5-1.5b-instruct和Qwen2.5-32b-instruct训练后压缩,提升推理速度。

2、DeepSeek-v3和DeepSeek-r1支持内置联网搜索,支持提交工单开白使用。详情查看官网文档。

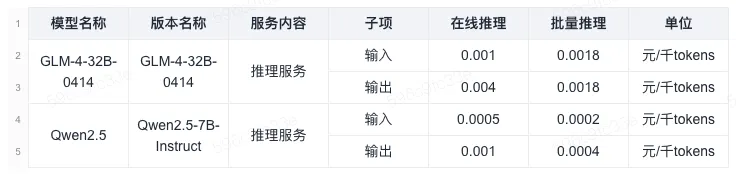

3、预置服务上线 GLM-4-32B-0414 系列、Qwen2.5-7B-Instruct 模型,含文本生成、深度思考模型,支持按量后付费。

-

计费详情:

-

使用说明文档:

「平台能力」

-

自定义模型导入支持SGLang框架,性能优于VLLM。

工具链升级

模型训练

-

DPO新增Qwen2.5-1.5B-Instruct、Qwen2.5-32B-Instruct模型,并支持全量和LoRA训练方法。

模型评估

-

模型评估新增裁判员自定义打分场景化Prompt模板,为不同业务场景提供更匹配的裁判员打分prompt模板,降低打分prompt理解成本,提高评估任务配置效率。

评论